Cos'è un file Robots.txt? Tutto ciò di cui hai bisogno per scrivere, inviare e ripetere la scansione di un file Robots per la SEO

Abbiamo scritto un articolo completo su come i motori di ricerca trovano, scansionano e indicizzano i tuoi siti web. Un passo fondamentale in questo processo è il robots.txt file, il gateway per un motore di ricerca per eseguire la scansione del tuo sito. Capire come costruire correttamente un file robots.txt è essenziale per l'ottimizzazione dei motori di ricerca (Gestione SEO).

Questo strumento semplice ma potente aiuta i webmaster a controllare il modo in cui i motori di ricerca interagiscono con i loro siti web. Comprendere e utilizzare in modo efficace un file robots.txt è essenziale per garantire un'indicizzazione efficiente di un sito Web e una visibilità ottimale nei risultati dei motori di ricerca.

Cos'è un file Robots.txt?

Un file robots.txt è un file di testo situato nella directory principale di un sito web. Il suo scopo principale è guidare i crawler dei motori di ricerca su quali parti del sito dovrebbero o non dovrebbero essere scansionate e indicizzate. Il file utilizza il protocollo di esclusione robot (REP), uno standard utilizzato dai siti Web per comunicare con i web crawler e altri robot web.

Il REP non è uno standard Internet ufficiale ma è ampiamente accettato e supportato dai principali motori di ricerca. La più vicina a uno standard accettato è la documentazione dei principali motori di ricerca come Google, Bing e Yandex. Per ulteriori informazioni, visitare Specifiche del file Robots.txt di Google è raccomandato.

Perché Robots.txt è fondamentale per la SEO?

- Scansione controllata: Robots.txt consente ai proprietari di siti Web di impedire ai motori di ricerca di accedere a sezioni specifiche del loro sito. Ciò è particolarmente utile per escludere contenuti duplicati, aree private o sezioni con informazioni sensibili.

- Budget di scansione ottimizzato: I motori di ricerca assegnano un crawl budget per ogni sito web, il numero di pagine che un bot del motore di ricerca scansionerà su un sito. Non consentendo sezioni irrilevanti o meno importanti, robots.txt aiuta a ottimizzare questo budget di scansione, garantendo che le pagine più significative vengano scansionate e indicizzate.

- Tempo di caricamento del sito Web migliorato: Impedendo ai bot di accedere a risorse non importanti, robots.txt può ridurre il carico del server, migliorando potenzialmente il tempo di caricamento del sito, un fattore critico nella SEO.

- Prevenire l'indicizzazione di pagine non pubbliche: Aiuta a evitare che le aree non pubbliche (come i siti di staging o le aree di sviluppo) vengano indicizzate e appaiano nei risultati di ricerca.

Robots.txt Comandi essenziali e loro utilizzo

- Permettere: Questa direttiva viene utilizzata per specificare a quali pagine o sezioni del sito devono accedere i crawler. Ad esempio, se un sito web ha una sezione particolarmente rilevante per la SEO, il comando "Consenti" può garantire che venga sottoposta a scansione.

Allow: /public/- Disallow: L'opposto di "Consenti", questo comando indica ai bot dei motori di ricerca di non eseguire la scansione di alcune parti del sito web. Ciò è utile per le pagine senza valore SEO, come pagine di accesso o file di script.

Disallow: /private/- Caratteri jolly: I caratteri jolly vengono utilizzati per la corrispondenza dei modelli. L'asterisco (*) rappresenta qualsiasi sequenza di caratteri e il segno del dollaro ($) indica la fine di un URL. Sono utili per specificare un'ampia gamma di URL.

Disallow: /*.pdf$- Sitemap: Includere una posizione sulla mappa del sito nel file robots.txt aiuta i motori di ricerca a trovare ed eseguire la scansione di tutte le pagine importanti di un sito. Questo è fondamentale per la SEO poiché aiuta nell’indicizzazione più rapida e completa di un sito.

Sitemap: https://martech.zone/sitemap_index.xmlRobots.txt Comandi aggiuntivi e loro utilizzo

- Agente utente: Specifica a quale crawler si applica la regola. "User-agent: *" applica la regola a tutti i crawler. Esempio:

User-agent: Googlebot- Indice: Sebbene non facciano parte del protocollo standard robots.txt, alcuni motori di ricerca comprendono a noindex direttiva in robots.txt come istruzione di non indicizzare l'URL specificato.

Noindex: /non-public-page/- Ritardo scansione: Questo comando chiede ai crawler di attendere un periodo di tempo specifico tra gli accessi al tuo server, utile per i siti con problemi di carico del server.

Crawl-delay: 10Come testare il file Robots.txt

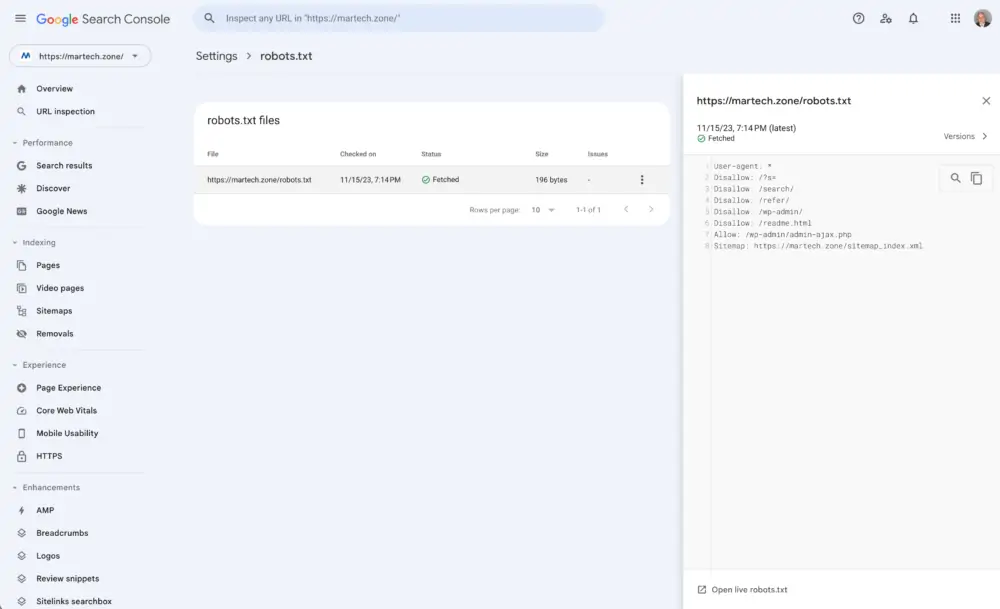

Anche se è sepolto Google Search Console, Search Console offre un tester per il file robots.txt.

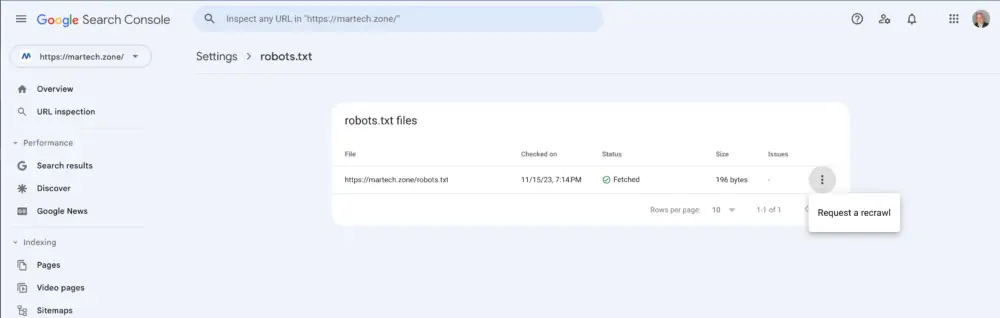

Puoi anche inviare nuovamente il file Robots.txt facendo clic sui tre punti a destra e selezionando Richiedi una nuova scansione.

Testa o invia nuovamente il file Robots.txt

Il file Robots.txt può essere utilizzato per controllare i robot IA?

Il file robots.txt può essere utilizzato per definire se AI i bot, inclusi web crawler e altri bot automatizzati, possono eseguire la scansione o utilizzare il contenuto del tuo sito. Il file guida questi bot, indicando a quali parti del sito web è consentito o meno l'accesso. L'efficacia di robots.txt nel controllare il comportamento dei bot IA dipende da diversi fattori:

- Adesione al Protocollo: I crawler dei motori di ricerca più affidabili e molti altri bot IA rispettano le regole stabilite

robots.txt. Tuttavia, è importante notare che il file è più una richiesta che una restrizione applicabile. I bot possono ignorare queste richieste, soprattutto quelle gestite da entità meno scrupolose. - Specificità delle istruzioni: Puoi specificare istruzioni diverse per bot diversi. Ad esempio, potresti consentire a specifici bot IA di eseguire la scansione del tuo sito vietandone altri. Questo viene fatto utilizzando il

User-agentdirettiva nelrobots.txtesempio di file sopra. Per esempio,User-agent: Googlebotspecificherebbe le istruzioni per il crawler di Google, mentreUser-agent: *si applicherebbe a tutti i bot. - limitazioni: Mentre

robots.txtpuò impedire ai bot di eseguire la scansione di contenuti specifici; non nasconde loro il contenuto se già conoscono il file URL. Inoltre, non fornisce alcun mezzo per limitare l'utilizzo del contenuto una volta sottoposto a scansione. Se sono necessarie la protezione del contenuto o restrizioni di utilizzo specifiche, potrebbero essere necessari altri metodi come la protezione tramite password o meccanismi di controllo degli accessi più sofisticati. - Tipi di bot: Non tutti i robot AI sono legati ai motori di ricerca. Vari bot vengono utilizzati per scopi diversi (ad esempio, aggregazione di dati, analisi, scraping di contenuti). Il file robots.txt può essere utilizzato anche per gestire l'accesso di questi diversi tipi di bot, purché aderiscano al REP.

I robots.txt file può essere uno strumento efficace per segnalare le tue preferenze relative alla scansione e all'utilizzo dei contenuti del sito da parte dei bot AI. Tuttavia, le sue capacità si limitano a fornire linee guida piuttosto che a imporre un rigido controllo degli accessi, e la sua efficacia dipende dalla conformità dei robot al Robots Exclusion Protocol.

Il file robots.txt è uno strumento piccolo ma potente nell'arsenale SEO. Può influenzare in modo significativo la visibilità di un sito Web e le prestazioni dei motori di ricerca se utilizzato correttamente. Controllando quali parti di un sito vengono scansionate e indicizzate, i webmaster possono garantire che i loro contenuti più preziosi vengano evidenziati, migliorando i loro sforzi SEO e le prestazioni del sito web.